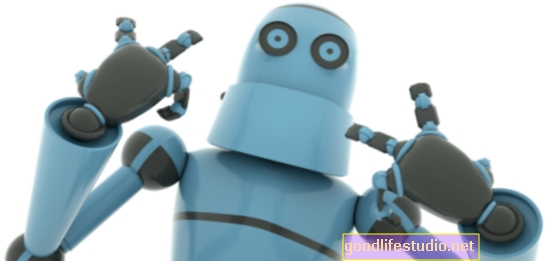

Des robots qui parlent de déchets perturbent les adversaires humains

Le trash talk est une tactique utilisée depuis longtemps pour agacer les adversaires du jeu, et maintenant une nouvelle étude montre que les mots décourageants peuvent affecter le jeu, même lorsqu'ils proviennent d'un robot.

Le discours de trash dans l'étude était décidément doux, avec des énoncés tels que "Je dois dire que vous êtes un joueur terrible" et "Au cours du jeu, votre jeu est devenu confus." Pourtant, les personnes qui ont joué à un jeu particulier avec le robot - un robot humanoïde disponible dans le commerce connu sous le nom de Pepper - ont eu des performances pires lorsque le robot les décourageait et mieux lorsque le robot les encourageait.

L'auteur principal Aaron M. Roth a déclaré que certains des 40 participants à l'étude étaient techniquement sophistiqués et comprenaient parfaitement qu'une machine était la source de leur inconfort.

«Un participant a dit:« Je n'aime pas ce que dit le robot, mais c'est ainsi qu'il a été programmé, donc je ne peux pas le blâmer »», a déclaré Roth, qui a mené l'étude alors qu'il était étudiant à la maîtrise au Carnegie. Institut de robotique de l'Université Mellon (CMU).

Mais les chercheurs ont constaté que, dans l’ensemble, la performance humaine fluctuait indépendamment des connaissances techniques des participants.

L'étude, présentée le mois dernier à la Conférence internationale de l'IEEE sur les robots et la communication interactive humaine (RO-MAN) à New Delhi, en Inde, s'écarte des études d'interaction homme-robot typiques, qui ont tendance à se concentrer sur la façon dont les humains et les robots peuvent au mieux travailler ensemble.

«Il s'agit de l'une des premières études sur l'interaction homme-robot dans un environnement où ils ne coopèrent pas», a déclaré le co-auteur Dr Fei Fang, professeur adjoint à l'Institut de recherche sur les logiciels.

L'étude a des implications importantes pour un monde où le nombre de robots et d'appareils de l'Internet des objets (IoT) dotés de capacités d'intelligence artificielle devrait augmenter de manière exponentielle.

«Nous pouvons nous attendre à ce que les aides à domicile se montrent coopératives», a-t-elle déclaré, «mais dans des situations telles que les achats en ligne, elles peuvent ne pas avoir les mêmes objectifs que nous.»

L'étude était le résultat d'un projet d'étudiant, un cours enseigné par Fang. Les étudiants voulaient explorer les utilisations de la théorie des jeux et de la rationalité limitée dans le contexte des robots, ils ont donc conçu une étude dans laquelle les humains seraient en concurrence avec un robot dans un jeu appelé «Guards and Treasures». Un soi-disant jeu Stackelberg, les chercheurs l'utilisent pour étudier la rationalité; Fang l'utilise dans ses recherches sur la cybersécurité pour étudier l'interaction défenseur-attaquant.

Pour l'étude, chaque participant a joué au jeu 35 fois avec le robot, tout en appréciant les mots encourageants du robot ou en s'énervant avec des remarques dédaigneuses. Bien que la rationalité des joueurs humains s’améliore à mesure que le nombre de parties jouées augmente, ceux qui ont été critiqués par le robot n’ont pas marqué aussi bien que ceux qui ont été félicités.

Il est bien connu que les performances d'une personne sont affectées par ce que les autres disent, mais l'étude montre que les humains réagissent également à ce que disent les machines, a déclaré le Dr Afsaneh Doryab, un scientifique des systèmes à l'Institut d'interaction homme-machine (HCII) de la CMU au cours de la étudie et maintenant professeur adjoint en systèmes d'ingénierie et environnement à l'Université de Virginie.

La capacité de cette machine à susciter des réponses pourrait avoir des implications pour l'apprentissage automatisé, le traitement de la santé mentale et même l'utilisation de robots comme compagnons, a-t-elle déclaré.

Les travaux futurs pourraient se concentrer sur l'expression non verbale entre les robots et les humains, a déclaré Roth, maintenant titulaire d'un doctorat. étudiant à l'Université du Maryland. Fang suggère qu'il faut en apprendre davantage sur la façon dont différents types de machines - par exemple, un robot humanoïde par rapport à une boîte d'ordinateur - pourraient provoquer des réactions différentes chez les humains.

Source: Université Carnegie Mellon