Documents secrets: Facebook semble mettre les fonctionnalités au-dessus de la sécurité des utilisateurs

Facebook, le monstre de 13 ans avec 1,23 milliard d'utilisateurs actifs, génère plus de 8 milliards de dollars de revenus par trimestre, dont 3 milliards de dollars de revenus nets (par exemple, des bénéfices).

Mais avec autant d'utilisateurs, Facebook semble avoir relégué la sécurité des utilisateurs à une préoccupation secondaire. Jusqu'au début de cette année, Facebook n'employait que 4500 personnes pour examiner le contenu. Ce qui ressemble à beaucoup de gens jusqu'à ce que vous vous rendiez compte que ces 1,23 milliard d'utilisateurs actifs partagent milliards de contenus chaque jour, avec des millions de plaintes d'utilisateurs au sujet du contenu Facebook déposées chaque jour.

Facebook a-t-il un sérieux problème de sécurité des utilisateurs entre les mains? Un tout juste publié Gardien l'examen de documents internes secrets suggère que son problème est hors de contrôle.

Facebook a reconnu avoir une sorte de problème quand, plus tôt cette année, il a accepté de presque doubler son personnel d'examen - à 7500 - au milieu d'allégations selon lesquelles l'entreprise ne fait tout simplement pas (ou ne s'en soucie peut-être pas?) Lorsque du contenu potentiellement dangereux fait l'objet d'un trafic sur sa plate-forme. . Vous ne doublez pas votre personnel de modération si tout va bien.

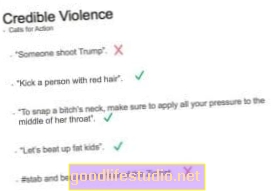

Maintenant, The (UK) Guardian a publié des détails étonnants sur les directives de modération de contenu de Facebook, extraits de plus de 100 manuels de formation et de documentation secrets et internes. C’est un peu dérangeant que tous ces éléments importants ne figurent pas dans un seul manuel remis aux modérateurs de Facebook lors de leur embauche.Au lieu de cela, cela semble être une approche fragmentaire de la politique, entraînant ce qui semble être des informations contradictoires, une modération inégale et très peu de fiabilité dans la façon dont ses politiques de modération fonctionnent réellement dans le monde réel.

«Facebook ne peut pas garder le contrôle de son contenu», a déclaré une source. «Il est devenu trop grand, trop vite.»

De nombreux modérateurs s'inquiètent de l'incohérence et de la nature particulière de certaines politiques. Ceux sur le contenu sexuel, par exemple, seraient les plus complexes et déroutants.

À titre d'exemple minuscule de la quantité de contenu modérée par Facebook, les articles notent: «Un document indique que Facebook examine plus de 6,5 millions de rapports par semaine concernant des comptes potentiellement faux - connus sous le nom de FNRP (faux, pas de vraie personne).» Et ce n'est que pour les faux comptes. Imaginez combien de millions de rapports supplémentaires représentent le contenu réel.

Caractéristiques avant réflexion

Avant de réfléchir à la façon dont les gens pourraient utiliser (et abuser) d'une nouvelle fonctionnalité, Facebook semble favoriser le déploiement de choses et trouver comment les modérer après coup. Regardez Facebook Live, un service de streaming vidéo qui permet aux gens de filmer tout ce qui se passe dans leur vie sur le moment. À quoi pensaient-ils que les gens finiraient par l'utiliser?

Cela montre un manque constant de réflexion sur les problèmes et de les résoudre de manière proactive avant qu'ils ne surviennent. Ou se tromper du côté de: "Hé, allons-y et voyons quel genre de tollé cela suscite avant de faire quoi que ce soit." (Tout cela au nom de la «liberté d'expression», bien sûr, en ignorant le fait que Facebook est une plate-forme mondiale.) 1

Où ai-je mis à nouveau cette directive de modération?

Et peut-être les mettre tous dans un seul manuel? Ainsi, les modérateurs savent où chercher et que chaque ligne directrice soit cohérente?

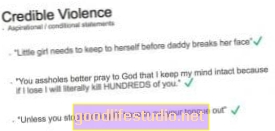

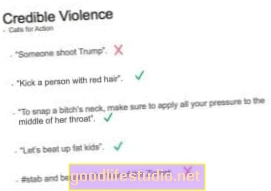

Les vidéos d'automutilation conviennent parfaitement au monde de Facebook, car la personne est «en détresse». Il en va de même pour la cruauté envers les animaux (peut-être parce que l'animal est en détresse?). "Revenge porn" est également acceptable, si le modérateur ne peut pas confirmer un manque de consentement des deux parties (ce qui, j'imagine, pourrait être assez difficile à faire en temps opportun).

"Certaines photos d'abus physiques non sexuels et de brimades d'enfants ne doivent pas être supprimées ou" traitées "à moins qu'elles ne comportent un élément sadique ou festif." Tant que vous gardez le sadisme et les célébrations hors de vos images et vidéos violentes, apparemment Facebook les autorisera.

Selon les documents, «les vidéos de morts violentes sont dérangeantes mais peuvent aider à sensibiliser. Pour les vidéos, nous pensons que les mineurs ont besoin de protection et que les adultes doivent avoir le choix. Nous qualifions les vidéos de «dérangeantes» de la mort violente d’humains. » On ne sait pas où le contenu suicidaire - comme les vidéos en direct ou les menaces - tombe dans les politiques de modération de Facebook, mais il semble être autorisé.

Facebook doit donner la priorité à la sécurité des utilisateurs

Certains ont appelé à une réglementation plus stricte de Facebook, car il est le gardien de tout ce contenu (tout comme un diffuseur de télévision est le gardien du contenu sur son réseau):

Un rapport de députés britanniques publié le 1er mai a déclaré que «les sociétés de médias sociaux les plus grandes et les plus riches sont honteusement loin de prendre des mesures suffisantes pour lutter contre les contenus illégaux ou dangereux, pour mettre en œuvre les normes communautaires appropriées ou pour assurer la sécurité de leurs utilisateurs».

Se tromper du côté de la «liberté d'expression» peut sembler une bonne idée, surtout pour une entreprise américaine. Mais les réseaux sociaux sont principalement des communautés en ligne - ils ne ressemblent pas beaucoup aux journaux. L'objectif principal de Facebook est de connecter les gens les uns aux autres. Il s'ensuit que leurs lignes directrices refléteraient davantage cette diversité et seraient conçues pour la sécurité de cette communauté, plutôt qu'une sorte de mantra de publication d'informations ou d'idéologie vide.

Nous aimerions que Facebook soit plus transparent sur la façon dont il modère des millions de personnes et de contenus chaque jour. Faire plus de lumière sur ces questions permet de mettre en évidence les problèmes et donne à Facebook l’opportunité d’améliorer la sécurité de sa communauté. Et nous aimerions voir Facebook consacrer beaucoup plus de ses revenus pour s'assurer qu'il dispose d'un personnel suffisant pour assurer la sécurité de sa plate-forme. Pour tous les utilisateurs.

Pour plus d'informations

Notes de bas de page:

- Oh, et notez que si vous avez 100 000 abonnés de plus sur Facebook, à leurs yeux, cela fait de vous une «personnalité publique» - et non soumise à la vie privée ou à d'autres protections des gens ordinaires. [↩]

-for-depression.jpg)